Pour un responsable SEO gérant un catalogue de plus de 10 000 références, le constat est souvent frustrant. Vous déployez des trésors d’ingéniosité pour optimiser chaque fiche produit, mais la Google Search Console révèle une vérité cruelle : une large part de votre inventaire, notamment les pages situées au-delà du troisième niveau de profondeur, semble invisible pour Googlebot. Le nombre de pages crawlées stagne, et les nouvelles collections peinent à être indexées. Face à cette situation, les réflexes habituels consistent à vérifier le sitemap.xml, à retravailler le maillage de surface ou à multiplier les liens.

Ces actions sont nécessaires, mais rarement suffisantes. Elles traitent les symptômes sans s’attaquer à la cause profonde. Et si le problème n’était pas la *découverte* de vos pages, mais la *rentabilité* du chemin que Google doit emprunter pour y accéder ? Le budget de crawl n’est pas une simple limite, c’est une véritable économie. Googlebot alloue son temps et ses ressources là où il perçoit le plus de valeur et le moins de friction. Toute complexité technique, toute redondance, toute milliseconde perdue constitue une micro-décision pour le robot de rebrousser chemin et d’investir son temps ailleurs. Il ne s’agit plus de gérer un budget, mais de colmater une hémorragie de crawl.

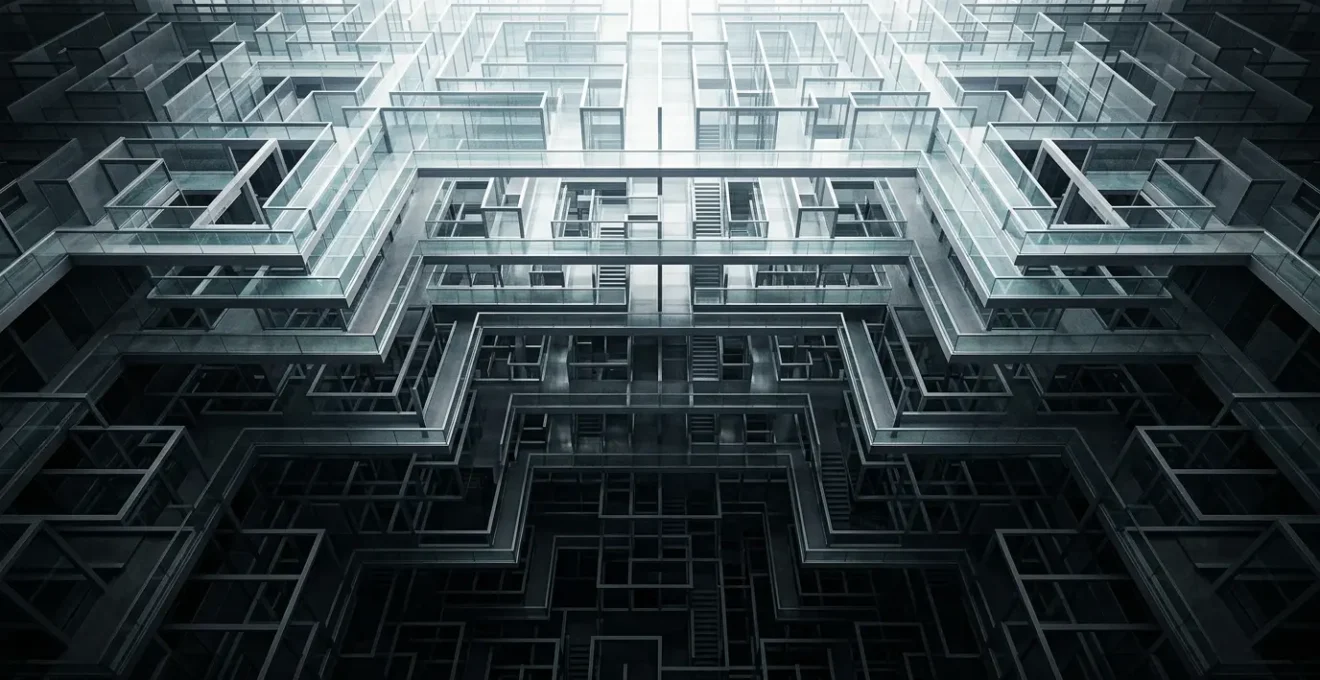

Cet article adopte une approche d’analyse technique et d’expert en logs pour débusquer ces fuites invisibles. Nous allons disséquer les erreurs structurelles qui épuisent votre budget de crawl, depuis les architectures trop complexes jusqu’aux signaux techniques que vous envoyez sans le savoir. L’objectif est de transformer votre site d’un labyrinthe coûteux en une autoroute efficace pour les robots, garantissant que chaque page stratégique, même la plus profonde, reçoive l’attention qu’elle mérite.

Pour comprendre et corriger les raisons pour lesquelles Google délaisse vos pages stratégiques, cet article est structuré pour diagnostiquer chaque point de fuite potentiel de votre budget de crawl. Le sommaire suivant vous guidera à travers les optimisations techniques essentielles.

Sommaire : Diagnostiquer et réparer les fuites de budget de crawl sur un site e-commerce

- Règle des 3 clics : comment aplatir votre architecture pour faciliter l’accès aux robots ?

- Paramètres d’URL : l’erreur de configuration qui crée 1 million d’URL inutiles

- Comment une simple chaîne de redirections 301 gaspille votre budget de crawl ?

- Faut-il vraiment mettre en vos liens vers les mentions légales ?

- Quand les erreurs serveur signalent-elles à Google d’arrêter de crawler votre site ?

- Pourquoi Googlebot ignore-t-il la moitié de vos pages stratégiques ?

- LCP ou CLS : lequel corriger en priorité pour sauver votre référencement ?

- Comment faire indexer vos nouvelles pages par Google en moins de 24h ?

Règle des 3 clics : comment aplatir votre architecture pour faciliter l’accès aux robots ?

Le mythe tenace de la « règle des 3 clics » a longtemps dicté les stratégies d’architecture web, suggérant que toute page importante doit être accessible en trois clics maximum depuis l’accueil. Pour Googlebot, cette règle est une simplification excessive. Ce qui compte n’est pas tant le nombre de clics pour un utilisateur, mais la profondeur de crawl : le nombre de liens que le robot doit suivre pour atteindre une page. Une page peut être à 5 clics, mais si elle est solidement maillée depuis des pages de catégories puissantes et fréquemment visitées, sa profondeur de crawl perçue sera faible.

L’objectif n’est pas de tout ramener en surface, mais de créer une architecture logique et pyramidale qui guide efficacement le robot. Une structure aplatie consiste à réduire les niveaux hiérarchiques inutiles et à renforcer les liens transversaux (par exemple, entre produits similaires ou via des blocs de « recommandations ») pour créer des raccourcis. Cela permet de distribuer le « jus de lien » (PageRank) plus uniformément et signale à Google que même les pages profondes font partie intégrante de votre écosystème de contenu.

Comme le montre cette visualisation, une architecture bien pensée relie les différents niveaux de profondeur, évitant l’isolement des pages produits. Le véritable enjeu est donc la qualité du maillage interne. Chaque lien est un vote de confiance. Un produit en profondeur 4, s’il n’est lié que par une succession de pages de sous-catégories à faible autorité, a peu de chances d’être considéré comme prioritaire. En revanche, s’il est mis en avant sur une page catégorie de niveau 2, son importance perçue augmente drastiquement.

Paramètres d’URL : l’erreur de configuration qui crée 1 million d’URL inutiles

Pour un site e-commerce, les filtres à facettes (par couleur, taille, marque, etc.) sont un outil indispensable pour l’expérience utilisateur. Pour Googlebot, ils représentent l’une des plus grandes sources de gaspillage de budget de crawl. Chaque combinaison de filtres peut générer une nouvelle URL avec des paramètres (?couleur=bleu&taille=M), créant une quasi-infinité de pages au contenu très similaire, voire dupliqué. Ce phénomène, connu sous le nom de « dilution de crawl », force Google à explorer des milliers d’URL sans valeur ajoutée, au détriment de vos pages produits uniques.

Laisser Google explorer librement ces facettes est l’équivalent de l’envoyer dans un labyrinthe sans fin. L’enjeu est de lui indiquer clairement quelles sont les pages canoniques et quels chemins il doit ignorer. Pour ce faire, plusieurs solutions techniques existent, leur pertinence variant selon la plateforme e-commerce utilisée. La gestion des paramètres dans la Google Search Console est une première étape, mais elle est souvent insuffisante. Une bonne configuration des balises `rel= »canonical »` est cruciale pour indiquer la version « maîtresse » d’une page, tandis que le fichier `robots.txt` peut être utilisé pour bloquer préventivement le crawl de certains paramètres connus pour leur faible valeur (comme les tris par prix).

L’analyse des logs serveur est ici votre meilleur allié. Elle permet d’identifier précisément quels paramètres sont les plus crawlés par Googlebot et de prioriser les actions. Le tableau suivant synthétise les approches courantes selon les principaux CMS e-commerce.

| CMS | Solution Canonical | Solution Robots.txt | Impact GSC |

|---|---|---|---|

| Magento | Configuration native des canonicals | Blocage des paramètres de filtres | Réduction jusqu’à 70% des URL crawlées |

| Shopify | Apps tierces nécessaires | Accès limité au robots.txt | Amélioration modérée |

| PrestaShop | Module SEO avancé requis | Configuration manuelle possible | Gain de 40-60% du budget |

En maîtrisant ces configurations, vous transformez une source majeure de bruit en un système de navigation clair pour les robots, concentrant ainsi leur attention sur votre catalogue réel.

Comment une simple chaîne de redirections 301 gaspille votre budget de crawl ?

Les redirections 301 sont un outil essentiel de la boîte à outils SEO, utilisées pour transférer l’autorité d’une ancienne URL vers une nouvelle. Cependant, lorsqu’elles s’enchaînent, elles créent une toxicité structurelle qui draine silencieusement le budget de crawl. Une chaîne de redirections (Page A -> Page B -> Page C) force Googlebot à effectuer plusieurs requêtes serveur successives pour atteindre la destination finale. Chaque requête supplémentaire ajoute de la latence et consomme une fraction de votre précieux budget de crawl.

Isolément, l’impact est minime. Mais sur un site e-commerce de grande taille, avec des années d’historique de migrations, de refontes de catégories ou de changements de structure d’URL, des milliers de ces chaînes peuvent exister. L’effet cumulé devient alors significatif. Une analyse technique approfondie montre qu’une latence de seulement 300ms sur 1000 chaînes de redirections peut représenter jusqu’à 5 minutes de crawl perdues chaque jour. Ce temps aurait pu être utilisé pour découvrir et indexer de nouvelles pages produits.

La solution consiste à identifier et « aplatir » ces chaînes. L’objectif est de faire en sorte que tous les liens internes et les redirections pointent directement vers l’URL finale (Page A -> Page C). Pour prioriser cet effort colossal, la méthodologie suivante est recommandée :

- Identifier les chaînes : Utilisez un outil de crawl technique (comme Screaming Frog ou OnCrawl) pour lister toutes les chaînes de redirection de votre site.

- Prioriser par le trafic : Croisez ces données avec Google Analytics ou la Search Console pour identifier les chaînes qui affectent vos pages générant le plus de trafic ou de revenus. Ce sont celles à corriger en priorité.

- Corriger à la source : La correction la plus efficace consiste à mettre à jour les liens internes directement dans votre CMS ou votre code pour qu’ils pointent vers l’URL finale. Cela élimine la redirection dès le départ.

En nettoyant systématiquement ces « points de friction », vous rendez la navigation des robots plus fluide et vous maximisez la rentabilité de chaque seconde de leur visite.

Faut-il vraiment mettre en vos liens vers les mentions légales ?

Dans la quête d’optimisation du « jus de lien », une pratique courante a été d’appliquer l’attribut `rel= » »` sur les liens jugés non stratégiques, comme ceux menant aux mentions légales, aux conditions générales de vente (CGV) ou à la page de contact. L’idée était de ne pas « gaspiller » de PageRank sur ces pages. Cependant, cette vision est non seulement dépassée, mais elle peut aussi être contre-productive pour votre budget de crawl et votre crédibilité globale.

Il est crucial de comprendre la distinction fondamentale que fait Google. Comme l’a précisé l’expert de Google, Gary Illyes, la directive `` n’est plus une instruction stricte mais un simple indice. Surtout, elle n’empêche en aucun cas le crawl. Pour préserver activement le budget de crawl, la seule méthode efficace est d’utiliser une directive `Disallow` dans le fichier `robots.txt`.

Le est un ‘hint’ pour le PageRank, mais n’empêche pas le crawl. Pour préserver le budget de crawl, la seule directive efficace est le robots.txt.

– Gary Illyes, Google Search Central Documentation

Plus important encore, masquer ces liens peut envoyer un signal négatif en termes de confiance. Dans le cadre de ses directives E-A-T (Expertise, Authoritativeness, Trustworthiness), Google s’attend à trouver facilement ces pages légales. Elles sont un signal de confiance qui prouve que votre site est une entité commerciale légitime et transparente. Les cacher avec un `` pourrait être interprété comme une tentative de dissimulation, nuisant à la perception globale de la fiabilité de votre site. En somme, l’économie de PageRank potentielle est négligeable face au risque de dégrader la confiance que Google vous accorde.

Quand les erreurs serveur signalent-elles à Google d’arrêter de crawler votre site ?

La santé de votre serveur est un indicateur direct de la fiabilité de votre site pour Googlebot. Des erreurs serveur fréquentes et non résolues sont un signal fort pour que le robot réduise, voire cesse, ses visites. On distingue principalement deux types d’erreurs nuisibles : les erreurs 5xx et les « soft 404 ». Une erreur 5xx (500 Internal Server Error, 503 Service Unavailable) est un mur. Elle indique à Google que le serveur est incapable de répondre. Si ces erreurs persistent, Googlebot va progressivement espacer ses visites, considérant que le site n’est pas fiable, ce qui affecte directement l’indexation de nouvelles pages.

Plus insidieuses, les soft 404 sont une fuite silencieuse de budget de crawl. Il s’agit de pages qui renvoient un code de succès (200 OK) mais dont le contenu est vide ou indique qu’un produit est en rupture de stock sans proposer d’alternative. Google comprend qu’il s’agit d’une page sans intérêt pour l’utilisateur, mais comme le code est « 200 OK », il continue de la crawler. Comme le confirme Gary Illyes de Google, les soft 404 consomment le budget de crawl inutilement. Multipliées par des milliers de références en fin de vie, elles représentent un gaspillage colossal.

Une gestion proactive des erreurs serveur est donc non négociable. Il faut monitorer activement ces signaux et y répondre rapidement pour maintenir la confiance du robot.

Plan d’action pour maîtriser les erreurs serveur

- Monitorer quotidiennement : Surveillez le rapport de couverture et la section « Statistiques de crawl » dans la Google Search Console pour détecter toute augmentation anormale du taux d’erreurs.

- Identifier les soft 404 : Utilisez le rapport de couverture de la GSC et les outils de crawl tiers pour lister toutes les URL identifiées comme « soft 404 ».

- Distinguer les erreurs : Apprenez à différencier une erreur 503 (souvent temporaire, liée à une surcharge) d’une erreur 500 (plus critique, liée au code).

- Configurer les en-têtes : Pour les maintenances planifiées, implémentez un en-tête HTTP `Retry-After` avec un code 503. Cela indique poliment à Google de revenir plus tard sans pénaliser votre budget de crawl.

- Corriger les soft 404 : Pour les pages de produits épuisés, mettez en place une redirection 301 vers un produit de remplacement ou une catégorie pertinente, ou renvoyez un code 404 ou 410 si le produit ne reviendra jamais.

En traitant votre serveur comme le fondement de votre relation avec Google, vous assurez une exploration stable et efficace de votre catalogue.

Pourquoi Googlebot ignore-t-il la moitié de vos pages stratégiques ?

L’un des constats les plus déroutants pour les grands sites e-commerce est que, malgré une structure apparemment saine, une part significative du catalogue reste non explorée. Une étude révélait déjà en 2018 que plus de 50% des pages des sites de grande taille ne sont simplement jamais visitées par Google. La raison est simple : Google pratique un arbitrage de crawl basé sur la loi de Pareto. Il concentre son budget sur les pages qu’il juge les plus importantes et les plus performantes, délaissant le reste.

Cette « importance » est déterminée par une combinaison de signaux : la popularité (backlinks, trafic direct), la fraîcheur du contenu, et surtout la qualité du maillage interne. Des données d’analyse montrent souvent que 9% des URL d’un site peuvent concentrer 25% du crawl de Google et générer plus de 66% des visites. Google apprend à reconnaître les « zones » de haute qualité de votre site et y retourne fréquemment, tandis qu’il considère les zones profondes et mal maillées comme un « marécage » à faible retour sur investissement.

Si vos nouvelles pages produits sont situées dans ces zones délaissées, elles ont peu de chance d’être découvertes. La stratégie ne consiste donc pas à « forcer » Google à tout crawler, mais à augmenter la valeur perçue de vos pages stratégiques. Cela passe par :

- Le « Content Pruning » : Identifier et dé-indexer (ou améliorer) les pages à faible valeur (pages vides, contenu dupliqué, anciennes références) qui consomment du budget de crawl pour rien.

- Le renforcement du maillage : Créer des liens vers vos pages produits profondes depuis des pages à forte autorité (page d’accueil, pages de catégories principales, articles de blog populaires).

- L’optimisation de la qualité : S’assurer que chaque page produit offre un contenu unique et riche (descriptions détaillées, avis clients, photos de haute qualité) pour signaler sa valeur.

En nettoyant les zones de faible qualité et en renforçant les signaux vers vos pages importantes, vous influencez directement l’arbitrage de Google en votre faveur.

LCP ou CLS : lequel corriger en priorité pour sauver votre référencement ?

Les Core Web Vitals (CWV) sont devenus un facteur de classement bien connu, mais leur impact sur le budget de crawl est souvent mal compris et hiérarchisé. Si le LCP (Largest Contentful Paint), le CLS (Cumulative Layout Shift) et le FID (First Input Delay) sont tous importants pour l’expérience utilisateur, leur influence sur la capacité de Googlebot à explorer votre site est très inégale. Pour un serveur qui doit répondre à des millions de requêtes, la vitesse de réponse initiale est le facteur dominant.

Un temps de chargement lent est un frein direct au crawl. Sachant que 40% des internautes quittent une page si elle met plus de 3 secondes à se charger, Google applique une logique similaire : un serveur lent signifie moins de pages explorées dans le temps imparti. Le LCP, et plus encore son précurseur le TTFB (Time to First Byte), ont donc un impact direct et majeur sur le budget de crawl. Un TTFB élevé signale un serveur surchargé ou mal configuré, incitant Google à ralentir la cadence pour ne pas « l’achever ». Le CLS, bien que crucial pour l’UX, est un problème qui survient après le chargement initial ; son impact sur le crawl est donc indirect et bien plus faible.

La hiérarchisation des efforts d’optimisation est donc claire pour un grand site e-commerce : la stabilité et la rapidité du serveur priment sur tout le reste. Le tableau suivant résume l’impact de chaque métrique sur le crawl et l’indexation.

| Métrique | Impact sur le crawl | Impact sur l’indexation | Priorité |

|---|---|---|---|

| LCP | Direct et majeur | Fort | 1 – Critique |

| TTFB | Direct et immédiat | Moyen | 2 – Haute |

| CLS | Indirect | Faible | 3 – Moyenne |

En conclusion, si vous devez choisir une bataille pour optimiser votre budget de crawl, concentrez-vous sans hésiter sur la réduction de votre TTFB et de votre LCP. C’est l’investissement le plus rentable pour permettre à Google d’explorer plus de pages, plus rapidement.

À retenir

- L’architecture du site et la qualité du maillage interne priment sur le simple nombre de clics pour déterminer l’importance d’une page aux yeux de Google.

- Les paramètres d’URL non maîtrisés sont la première cause d’hémorragie de budget de crawl sur les sites e-commerce, créant des milliers de pages inutiles.

- La vitesse du serveur (TTFB, LCP) a un impact direct et critique sur le volume de pages que Googlebot peut explorer ; c’est une priorité absolue.

Comment faire indexer vos nouvelles pages par Google en moins de 24h ?

Faire indexer une nouvelle page produit en moins de 24 heures n’est pas le fruit d’une astuce secrète, mais la conséquence logique d’une « économie de crawl » parfaitement optimisée. Toutes les actions décrites précédemment — aplatir l’architecture, nettoyer les paramètres, éliminer les redirections, corriger les erreurs et accélérer le serveur — construisent un environnement de confiance et d’efficacité pour Googlebot. Quand le robot sait que chaque URL qu’il visite sur votre site est pertinente, rapide et sans friction, il est naturellement enclin à revenir plus souvent et à explorer plus en profondeur.

Dans un contexte où Googlebot explore quotidiennement plus de 20 milliards de sites web, se démarquer nécessite de lui faciliter la tâche au maximum. Une fois que votre structure technique est saine, vous pouvez alors déployer des tactiques d’accélération pour signaler activement la présence de nouveau contenu. Ces actions ne fonctionneront que si les fondations sont solides. Une soumission via l’API d’indexation pour une page située sur un serveur lent et au fond d’une structure complexe sera tout simplement ignorée.

Pour une indexation express sur une base saine, la stratégie combinée est la plus efficace :

- Publication et optimisation : Assurez-vous que la nouvelle page est complète, unique et optimisée dès sa mise en ligne.

- Intégration au sitemap XML : Ajoutez immédiatement la nouvelle URL à votre sitemap et assurez-vous que ce dernier est bien déclaré dans la GSC.

- Lien depuis un « Hub de découverte » : Créez un lien vers votre nouvelle page depuis une page de votre site qui est déjà très fréquemment crawlée par Google (ex: la page d’accueil, une page de catégorie mère, un article de blog populaire).

- Soumission via Google Merchant Center : Pour les produits e-commerce, l’intégration de votre flux dans le Merchant Center est un signal extrêmement puissant et rapide.

- Utilisation (prudente) de l’API d’indexation : N’utilisez l’API que pour notifier Google d’un changement majeur ou de la publication d’un contenu très important. Un usage excessif peut entraîner une perte de confiance.

En fin de compte, l’indexation rapide est la récompense d’un travail de fond sur la propreté technique et la pertinence structurelle de votre site.

Pour passer de la théorie à la pratique, l’étape suivante consiste à réaliser un audit complet de vos logs serveur afin de quantifier précisément ces fuites de crawl et de construire une feuille de route d’optimisation sur mesure.